Механическое ухо: технологии слушания от фонографа до нейросетей

Рубрикатор: (1) Концепция (2) История технологического слушания (3) Машинное слушание и нейросети (4) Как изменилось слушание (5) Эстетические последствия (6) Анализ звукового фрагмента (7) Заключение (8) Источники

Концепция

Тема «Механическое ухо: технологии слушания от фонографа до нейросетей» выбрана мной исходя из интереса к пересечению истории звукозаписи, современных технологий обработки звука и влияния этих процессов на восприятие аудиального пространства. Развитие технических средств, начиная с фонографа и магнитофона, а также современные нейросетевые алгоритмы, не только изменили способы фиксации звука, но и трансформировали само понятие слушания, создавая новые формы аудиального опыта. Мне особенно важно исследовать, как технологии вмешиваются в процесс восприятия звука и как это отражается в художественных и научных практиках.

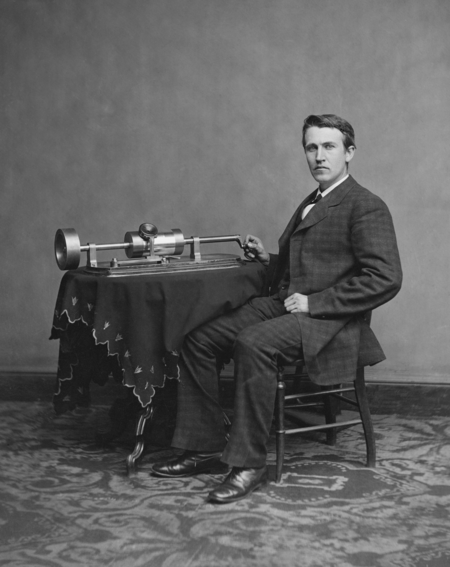

Рис. 1. Ухо. Источник: [1]. Рис. 2. Эдисон и фонограф. Источник: [2].

Рис. 3. Siri — нейросеть, обрабатывающая звук. Источник: [3].

Принцип отбора визуального материала строится на сопоставлении исторических и современных средств слухового анализа. В исследовании используются архивные изображения ранних устройств звукозаписи, схемы работы фонографов и магнитофонов, спектрограммы и визуализации нейросетей, а также примеры современных интерфейсов аудиопрограмм. Такая подборка позволяет одновременно показать технологическую эволюцию и создать визуальную линию, отражающую изменения в способах слушания.

Структура исследования, выраженная в рубрикаторе, организована по принципу исторической и концептуальной последовательности: сначала формулируется базовая концепция, затем проводится исторический обзор, рассматриваются современные технологии анализа звука, анализируются последствия трансформации слушания, изучаются эстетические проявления и, наконец, проводится собственный мини-кейс анализа звукового фрагмента. Такой подход позволяет логично перейти от теории к практическому анализу и сделать выводы на основе сопоставления разных эпох и способов восприятия.

Текстовые источники для исследования выбирались по принципу полноты и разнообразия подходов к звуку: исторические исследования фонографии, работы по звукорежиссуре и musique concrète, современная литература по цифровому и машинному анализу аудиосигналов. Основная цель отбора — соединить академические трактаты, исторические документы и современные исследования, чтобы показать комплексную эволюцию слушания как культурного и технологического феномена.

Ключевой вопрос исследования формулируется следующим образом: Как развитие звуковых технологий изменило само понятие слушания — от человеческого восприятия к машинному вниманию? Гипотеза работы заключается в том, что с появлением каждой новой технологии слушания происходит не просто техническое улучшение фиксации звука, а трансформация способов восприятия, анализа и эстетического осмысления аудиального опыта. Эти изменения можно проследить через историческую эволюцию устройств, цифровизацию звука и современные практики машинного слушания, что делает возможным выявление как технических, так и культурно-эстетических закономерностей.

История технологического слушания

История технологического слушания — это история того, как звук, прежде связанный с телесным, живым, мгновенным присутствием, стал технически фиксируемым, редактируемым и анализируемым. Каждый этап развития аудиотехнологий не просто предлагал новый инструмент, но менял сам характер слушания: от непосредственного соприсутствия звука и слушателя — к машинному анализу как особой форме восприятия.

Рис. 4. Разговор двух мужчин в таверне, Жан-Шарль Месонье. Источник: [4].

Рис. 5. Спектрограмма мужского голоса. Источник: [5].

До конца XIX века звук существовал только в момент своего излучения. Его нельзя было «сохранить», «вернуть» или «проанализировать» вне памяти. Слушание было неотделимо от телесного опыта: слышать — значит находиться рядом, присутствовать. Звук не мог быть объектом исследования в нашем современном смысле: он исчезал вместе с моментом.

«Before the invention of sound-reproduction technologies, we are told, sound withered away. It existed only as it went out of existence.» (Sterne, 2003, p. 1)

(«До изобретения технологий звуковоспроизведения, как нам говорят, звук увядал. Он существовал только в тот момент, когда исчезал.») (Стерн, 2003, с. 1)

С изобретением фонографа в 1877 году появляется то, что Стерн называет новой формой слушания. Впервые звук стал отделим от источника, стал материальным следом, который можно хранить, многократно воспроизводить и изучать. Фонограф не просто записывал звук — он менял само отношение к аудиальному опыту. Слушатель мог услышать голос «из прошлого», «издалека», в отсутствие того, кто его производит.

«The telephone, phonograph, radio, and other tympanic sound-reproduction technologies could all be described, at their base, as 'machines to hear for them.'» (Sterne, 2003, p. 1)

(«Телефон, фонограф, радио и другие тимпанические технологии звуковоспроизведения все могли быть описаны, в своей основе, как „машины, чтобы слышать за них“.») (Стерн, 2003, с. 1)

Рис. 6. Фонограф Эдисона. Источник: [6].

Рис. 7. Граммофон Берлинера. Источник: [7].

Граммофон Берлинера превращает звук в массовый продукт. Стандартизируются форматы, качество, громкость. Техника задаёт параметры того, как нужно звучать. Слушание становится индустриализированным и предсказуемым.

С появлением магнитофона (1930–1960-е) звук можно резать, соединять, накладывать, перестраивать. Впервые аудиальное время становится конструируемым, а слушание — нелинейным. Монтаж меняет логику работы с аудио: звук превращается в редактируемое вещество.

Пьер Шеффер формулирует идею «звукового объекта» — того, что слышится вне связи с видимым источником. Технология позволяет слушать звук как автономную сущность, как материал анализа. Это первое системное теоретическое описание технологически опосредованного слуха.

С 1980-х звук переходит в цифровой формат: семплирование, DAW, нелинейный монтаж. Слушание становится программируемым: его структура зависит от цифровых операций. Появляется визуальное слушание — спектрограммы и графические интерфейсы заменяют чисто слуховой анализ.

С 2000–2020-х происходит переход к автоматическому анализу аудио: распознавание речи, классификация звуков, выделение источников. Глубокие сети (Wav2Vec2, YAMNet, Whisper, Demucs) позволяют моделям слушать иначе, чем человек: через паттерны, статистику, эмбеддинги. Слушание становится распределённым между человеком и машиной.

Машинное слушание и нейросети

Рис. 8. Спектрограмма игры на скрипке. Источник: [8].

Машинное слушание — это не просто распознавание звука, а целая парадигма: алгоритмы учатся «слышать», анализировать и интерпретировать аудиосигналы так, как это делает человек, но на своих правилах. Модели глубокого обучения могут выделять сложные паттерны, классифицировать события и даже генерировать звук — всё это показывает, что слушание стало распределённым между человеком и машиной.

Нейросети обучаются на звуке в виде спектрограмм или raw-аудио. Они преобразуют волновую форму в более абстрактные репрезентации (эмбеддинги), из которых можно извлекать смысл: речь, шум, отдельные акустические события. Затем архитектуры, такие как сверточные сети (CNN) или трансформеры, анализируют эти репрезентации и принимают решения: «что это за звук», «какой источник», «нужно ли его сгенерировать».

Человеческий слух основан на биологических механизмах: ухо, нервные сигналы, опыт. Машина же «слышит» статистику: она не чувствует интонацию или намерение (если не обучена), но очень хорошо распознаёт структуры, которые человеку могут быть незаметны. Машинное слушание — это слушание через вычисления, а не через тело.

Исследователи Яндекса описали нейросетевую технологию, которая распознаёт голосовые команды даже в условиях сильного фонового шума. Это показывает, что современные сети могут «фильтровать» звук и фокусироваться на человеческой речи, несмотря на сложные звуковые условия.

Модель NSynth от Google/DeepMind — классический пример нейросети, которая генерирует новые звуки. Она учится на существующих звуках и создаёт абсолютно новые, соединяя тембры и временные структуры. Такой синтез — это не просто воспроизведение, а творческий аккумулированный слух машины.

Рис. 9. Google Magenta interface. Источник: [9].

Несмотря на мощь, машинное слушание имеет свои ограничения: — Нейросеть может ошибаться в непредсказуемых контекстах или при редких звуках. — У неё нет «интенции», и она не воспринимает смысл так, как человек. — Восприятие машины зависит от данных, на которых её обучили — если датасет слишком «чистый», ИИ плохо работает в реальном шуме. Также интересно, что человеческое восприятие может улучшать работу ИИ — как описано в экспериментах, где оценки людей используются для дообучения моделей.

Переход к машинному слушанию меняет нашу аудиокультуру: звук становится не только средством коммуникации, но и объектом анализа. Музыкальные и художественные практики могут использовать эмбеддинги, разделение источников и генерацию звука, создавая новые формы композиции и восприятия. Машина «слышит» слои, которые нам обычно не слышны — и художник может это использовать.

В будущем машинное слушание может стать ещё более интегрированным в нашу жизнь: — автоматическое обнаружение акустических событий (безопасность, экология), — звуковой дизайн с генеративным ИИ, — взаимодействие человека и машины через звук, где ИИ помогает слышать, а человек — направлять слушание. Это показывает, что слушание — это не просто опыт, но и технологическая система, эволюция которой продолжается.

Как изменилось слушание

Рис. 10. Советский катушечный магнитофон высшего класса «Санда МК-012 Стерео». Источник: [10].

До появления звукозаписывающих устройств слушание оставалось в основном непосредственным и телесным: звук существовал только «здесь и сейчас». Человек слушал пространство, а не объект; слушание означало участие в ситуации, а не работу с артефактами. Появление фонографа в конце XIX века радикально изменило это положение. Звук оказался отделённым от своего источника и времени. Это стало не просто техническим прорывом — изменилась сама структура слушания: человек впервые получил возможность слушать не событие, а след события. Эта перемена создала новый тип внимания — анализирующее слушание, в котором звук можно было повторять, останавливать, сравнивать, коллекционировать.

В первой половине XX века технологические средства — грампластинки, радио, магнитофон — сформировали новые социальные сценарии слушания. Радио сделало слушание массовым, общим опытом. Магнитофон — персональным, интимным. Студийная запись — конструируемым, а не непосредственным. Слушание стало деятельностью, встроенной в бытовые и медийные практики. Если раньше звук был частью природного мира, то в XX веке он стал частью медиа-инфраструктуры. Человек начал слушать не только «мир», но и произведённые звуковые среды — радиоэфир, записи, кино, рекламные джинглы, фоновые шумы городских систем.

Пьер Шеффер называл это переходом к «акузматическому слушанию» — когда человек концентрируется на самом звуке, а не на источнике. Этому способствовали технологии записи: они позволили услышать в звуке структуру, текстуру, материальность — то, что невозможно разглядеть в живой ситуации. Таким образом, слушание стало: — избирательным — мы учимся выделять нужное среди шума; — аналитическим — распознавать тембры, частоты, паттерны; — фрагментарным — звук стал объектом, который можно обрезать, копировать, повторять. Технологии изменили повседневное внимание, превратив слушание в навык фильтрации и сортировки звуковых потоков.

Эстетические последствия

Рис. 11. Пьер Шеффер и его «Акусмониум[англ.]». 1974. Semitransgenic. Источник: [11].

Появление звукозаписи не просто изменило способы фиксации звука — оно создало новые способы думать о звуке. Возможность удерживать аудио во времени сделала звук чем-то вроде осязаемого материала, с которым можно работать так же, как художник работает с глиной или фотографией. Если в дофонографическую эпоху звук был неуловимым и событийным, то в XX веке он стал объектом художественного конструирования. Это привело к сдвигу эстетической чувствительности: внимание стало направляться не только на интонации или мелодию, но и на тембр, шум, текстуру. Так возникла эстетика «слушания самого звука».

Пьер Шеффер предложил рассматривать звук как вещь, отвлекаясь от его источника. Акузматическое слушание дало художникам новый инструментарий: звук можно рассматривать по деталям, сравнивать, изолировать, анализировать. Эта новая модель восприятия породила новую эстетику: звук как абстрактная структура; внимание к микроуровню звучания; ценность случайных или «натуральных» шумов; эксперименты с повторами, сдвигами, монтажом. То, что раньше считалось помехой, стало художественным ресурсом.

С появлением магнитофона и позднее цифровой студии звук стал поддаваться гораздо более гибкой трансформации: фрагментированию, растяжению, реверберации, нелинейному монтажу. Это создало особую студийную эстетику, в которой: «натурального» звучания больше не существует — всё обработано; запись стала важнее живого исполнения; звук создаётся, а не случается. Вторая половина XX века привела к тому, что слушатель привык к сконструированным звуковым пространствам — от музыки до кино и ASMR. Ожидание «идеального» звучания стало культурной нормой.

С цифровизацией звук стал восприниматься не только как акустическое явление, но и как поток данных, который может «ломаться». Ошибка обработки, цифровой сбой, искажение — всё это стало частью новой эстетики, где ценится не идеальность, а след цифрового процесса. Эта эстетика строится на идее, что технологии не только улучшают звук, но и оставляют в нём собственные следы. Глитч-арт, экспериментальная электронная музыка, микротональные шумы — всё это примеры того, как технологические ограничения превращаются в художественный язык.

Когда в культуру вошли нейросети, слушание перестало быть исключительно человеческим. Звук стал тем, что анализируется и классифицируется алгоритмами: по частотам, спектру, паттернам. Это создало новую группу эстетических эффектов: — синтетичность: звук, который никогда не принадлежал реальному источнику; — гибридность: смешение человеческого и машинного восприятия; — «неправильная» интонация: ИИ-синтез часто даёт странные интонационные решения; — эстетика «непонимания»: когда алгоритм слышит иначе, чем человек.

Эстетические изменения затронули не только звук, но и сам формат слушателя. Сегодня мы слышим: — в наушниках → индивидуализированная звуковая среда; — через алгоритмы рекомендаций → звук как поток, который подстраивается под нас; — через мультимедийные платформы → звук как часть визуально-звуковых гибридов; — через ИИ-системы → звук как данные, а не как событие. Эстетика стала гибридной: мы одновременно слушаем звук и слушаем, как его слышат технологии. Это новый тип чувственности — распределённой между человеком, интерфейсами и алгоритмами.

Анализ звукового фрагмента

Рис. 12. Сравнение человека и ИИ. Изображение автора. Источник: [12].

В этом разделе я рассматриваю один и тот же звуковой фрагмент — короткую фразу человеческой речи и её синтетическую версию, созданную нейросетью. Этот пример позволяет увидеть, как технологии изменили сам способ слушания: не только то, что мы слышим, но и то, как мы слышим.

Я использую два подхода: человеческое слушание — внимание к дыханию, интонации, мелким шумам; машинное слушание — анализ спектра и повторяющихся паттернов. Технология делает звук не эфемерным событием, а объектом, который можно разложить на параметры и сравнить с его собственной копией.

В человеческой записи слышны те признаки, которые часто оказываются невидимыми в повседневном слушании, но важны в аналитическом: — микрошумы помещения; — неровности атаки звука — момент, когда голос «входит» в слово; — небольшие интонационные колебания, которые не запланированы заранее; — лёгкое дрожание окончания фразы, связанное с дыханием.

Рис. 13. Запись человека. Изображение автора.

В этом разделе я рассматриваю один и тот же звуковой фрагмент — короткую фразу человеческой речи и её синтетическую версию, созданную нейросетью. Этот пример позволяет увидеть, как технологии изменили сам способ слушания: не только то, что мы слышим, но и то, как мы слышим.

Для анализа я записал (а) короткую фразу на смартфон: «Я записываю этот звук для анализа». Вторая версия была создана нейросетевым синтезатором речи. Такой параллель позволяет наглядно сравнить человеческое и алгоритмическое звучание: где один звук «живёт» своим телом, другой возникает как результат вычисления.

Рис. 14. Скриншот. ttsmp3.com. 23 ноября, 2025.

Запись, созданная нейросетью, звучит иначе: — голос слишком ровный, «выглаженный»; — нет дыхания и шумов помещения; — переходы между звуками становятся предсказуемыми; — интонация слегка «обобщена», она звучит не как конкретная ситуация, а как статистически вероятный способ произнесения фразы; — иногда слышны лёгкие цифровые артефакты — металлические обертона или неестественная мягкость. Это демонстрирует важную идею: нейросеть не воспроизводит звук, а моделирует наиболее вероятный его вариант.

Если смотреть на спектрограммы двух версий, различия становятся ещё заметнее: в оригинале присутствуют хаотичные, неровные участки — следы телесных процессов и среды; в синтетической же версии они заменены чистыми полосами, которые отражают математическую структуру модели. Таким образом, сравнение показывает, что человеческое слушание связано с телом и контекстом, а машинное — с параметрическими признаками. Алгоритм слышит не голос, а набор частотных шаблонов.

На уровне эстетики синтетическая версия звучит слишком «идеально», но именно эта идеальность раскрывает важный сдвиг: звук перестал быть тем, что исчезает вместе с моментом. В машинном режиме слушания звук — это данные, которые можно снова и снова перезаписывать, моделировать, улучшать.

Это приводит к тому, что судьба звука перестаёт зависеть от источника: то, что раньше считалось мимолётным событием, теперь существует как параметрическая структура, которую можно бесконечно воспроизводить.

Анализ показывает, что оригинальный и синтетический звуки — это не две версии одного и того же события. Это два разных способа существования звука: телесный и вычислительный. Их сопоставление делает видимым (и слышимым), как изменилось слушание в эпоху технологий: от восприятия к анализу, от явления к модели, от уникального звучания к его вероятностной реконструкции.

Заключение

Развитие технологий звукозаписи — от фонографа до нейросетевых систем анализа аудио — постепенно перестроило не только способы фиксации и воспроизведения звука, но и само понятие слушания. Первоначально звук был связан с непосредственным телесным переживанием: голос, шаги, шум пространства исчезали вместе с их произнесением. Появление фонографа стало первым моментом отделения звука от источника. Именно здесь зародилась идея технологического слушания — слушания, в котором посредником становится устройство, способное сохранить, преобразовать и воспроизвести звук.

На протяжении XX века технологии продолжали расширять горизонты слухового опыта: радио, магнитная лента, студийная обработка, цифровой звук, алгоритмическая фильтрация, спектральный анализ. Каждая новая техника не просто добавляла новый инструмент — она перестраивала саму структуру внимания слушателя. Шум перестал быть дефектом, а стал материалом. Звук стал объектом исследования, анализа, манипуляции. Появилась возможность слушать «атопично» — разъединяя звук и источник, следуя не за голосом, а за его следом в записи.

С переходом к алгоритмическим и нейросетевым системам произошёл следующий, более глубокий сдвиг. Машины не просто записывают звук — они слушают иначе, чем человек. Они слышат не тембры и контуры, а статистические зависимости, спектральные паттерны, вероятностные структуры. Они одинаково уверенно различают речь, городской шум, птиц, механические вибрации; одинаково внимательно выделяют слабые сигналы среди шума. В этом возникает новый режим слушания, в котором человеческое ухо и машинное внимание сосуществуют, а иногда и конкурируют.

В ходе исследования стало видно, что слушание перестает быть исключительно физиологическим или эстетическим процессом и превращается в мультимодальный интерфейс взаимодействия человека, техники и данных. То, что мы считаем звуком, все чаще определяется алгоритмическими решениями: шумоподавлением, компрессией, классификацией, предсказанием. Машины выбирают, что считать «значимым» в аудиопотоке — и это формирует наш опыт. Мы слышим звук, уже прошедший через машинное внимание.

Эти изменения имеют не только технические, но и эстетические последствия. Саунд-арт обращается к машинному слушанию как к новому способу восприятия мира. Появляется художественная работа со спектрограммами, с ошибками алгоритмов, с неузнаваемыми режимами слуха. Звук становится и материалом, и процессом, и интерфейсом — пространством для эксперимента, в котором сталкиваются человеческая интуиция и машинная аналитика.

Таким образом, ключевой вопрос исследования — как развитие звуковых технологий изменило идею слушания — приводит к выводу: слушание сегодня является гибридной практикой, объединяющей телесный опыт, культурные привычки, технические протоколы и алгоритмическое восприятие. Это не замена человеческого слуха, а его расширение, в котором новые формы внимания — механические, цифровые, нейросетевые — становятся частью современной аудиокультуры. Технологии не просто позволяют слышать больше; они учат слушать иначе, открывая пространство для новых художественных, исследовательских и перцептивных возможностей.

Jonathan Sterne The Audible Past. — United States of America: Duke University Press, 2003. — 469 p.

Jonathan Sterne The Sound Studies Reader-Routledge. — London and New York: Routledge, 2012. — 577 с.

R. Murray Schafer The soundscape: our sonic environment and the tuning of the world. — New York: Destiny Books, 1977. — 322 с.

Ухо // Freepik. — URL: https://ru.freepik.com/free-photo/beauty-portrait-young-woman_26327000.htm#fromView=search& page=1& position=1& uuid=2f95a88a-db1c-4134-8733-023260bf933a& query=%D1%83%D1%85%D0%BE (дата обращения: 23.11.2025).

Levin C. Handy. Edison and phonograph // Wikimedia. — URL: https://ru.wikipedia.org/wiki/Файл: Edison_and_phonograph_edit2.jpg (дата обращения: 23.11.2025).

Apple. Siri // Siri User Guide. — URL: https://www.siriuserguide.com/what-is-siri/ (дата обращения: 23.11.2025).

Жан-Шарль Месонье. Разговор двух мужчин в таверне // Gallerix. — URL: https://gallerix.ru/storeroom/1307853604/N/4174611627/ (дата обращения: 23.11.2025).

Спектрограмма мужского голоса // Wikimedia. — URL: https://ru.wikipedia.org/wiki/Спектрограмма#/media/Файл: Spectrogram-19thC.png (дата обращения: 23.11.2025).

Томас Эдисон. Фонограф Эдисона // Sumter Museum. — URL: https://www.sumtermuseum.org/the-edison-phonograph/ (дата обращения: 23.11.2025).

Norman Bruderhofer. Collection of John Lampert-Hopkins. Граммофон Берлинера. Wikimedia. — URL: https://ru.wikipedia.org/wiki/Граммофон#/media/Файл: VictorVPhonograph.jpg (дата обращения: 23.11.2025).

Спектрограмма игры на скрипке. Wikimedia. — URL: https://ru.wikipedia.org/wiki/Спектрограмма#/media/Файл: Spectrogram_of_violin.png (дата обращения: 23.11.2025).

Google Magenta: Скриншот. Google Magenta. — URL: https://magenta.withgoogle.com (дата обращения: 23.11.2025).

Советский катушечный магнитофон высшего класса «Санда МК-012 Стерео». Wikimedia. — URL: https://ru.wikipedia.org/wiki/Магнитофон#/media/Файл: Санда_МК_-_012_СТЕРЕО.jpg (дата обращения: 23.11.2025).

Semitransgenic. Пьер Шеффер и его «Акусмониум[англ.]». 1974. Wikimedia. — URL: https://ru.wikipedia.org/wiki/Шеффер, _Пьер#/media/Файл: Psconcer.jpg (дата обращения: 23.11.2025).

Сравнение человека и ИИ. Изображение автора.

Запись человека. Изображение автора.

ttsmp3.com: Скриншот. ttsmp3.com — URL: https://ttsmp3.com/ai (дата обращения: 23.11.2025).